@로지스틱 회귀(Logistic Regression)

-답이 0 또는 1로 정해져 있는 이진 분류 문제에 사용되는 알고리즘

X (입력 특성), y (주어진 입력특성 X에 해당하는 실제 값), ŷ (y의 예측값)을 의미

예를 들어 X가 고양이 사진이라면, y의 예측값은 그 사진이 고양이 사진일 확률 알려줌

x는 n_x차원 상의 벡터

로지스틱 회귀의 파라미터 w와 b는 각각 n_x 차원 상의 벡터이고, 실수임

@입력 x와 파라미터 w와 b가 주어졌을 때 ŷ를 구하는 방법?

이진 분류를 위한 ŷhŷhŷ값은 y가 1일 확률을 의미하며 0 ≤ ŷ ≤ 1 사이의 값을 가져야 함

선형 회귀시 ŷh= W^TX+b 를 통해 계산하지만, 해당 값은 0과 1 범위를 벗어날 수 있음

*) 선형회귀함수: x와 y값을 통해 선형식 구하는 과정

로지스틱 회귀에서는 y의 예측값이 시그모이드 함수를 적용해 출력된 값

로지스틱 회귀를 위한 ŷ=σ(W^^TX+b) 로 구하게 됨

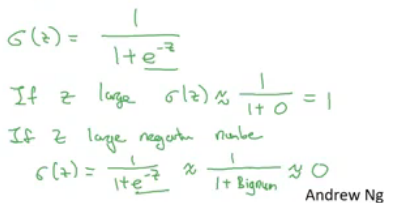

@시그모이드 함수(sigmoid)

z가 클수록 z의 시그모이드가 1에 수렴

참고)

'CS > AI | CV' 카테고리의 다른 글

| 계산 그래프 | Computation Graph (0) | 2020.12.31 |

|---|---|

| 경사하강법 | Gradient Descent (0) | 2020.12.31 |

| 로지스틱 회귀 비용함수 | Logistic Regression Cost Function (0) | 2020.12.31 |

| 이진 분류 | Binary Classification (0) | 2020.12.31 |

| 신경망(Neural Network), 지도학습(Supervised Learning) (0) | 2020.12.28 |